La collaborazione fra XR4Europe e XRMust si apre, in questo 2024, con una prima intervista dedicata ad uno dei nostri artisti preferiti dei mondi virtuali e delle performing arts.

Parliamo di Jason Moore, che con tutto il team di The MetaMovie ha sviluppato una produzione che negli ultimi anni è stata all’avanguardia nel settore, non soltanto per le potenzialità narrative e di entertainment che rappresenta ma anche per il modo in cui approccia la produzione virtuale, l’audience e le possibilità offerte oggi dal metaverso.

Quando, quasi quattro anni fa, ci siamo imbattuti alla Mostra del Cinema di Venezia in The MetaMovie Presents: Alien Rescue avevamo già capito che qualcosa di nuovo stava per farsi strada nel mondo della narrazione immersiva e lasciare indelebilmente il segno.

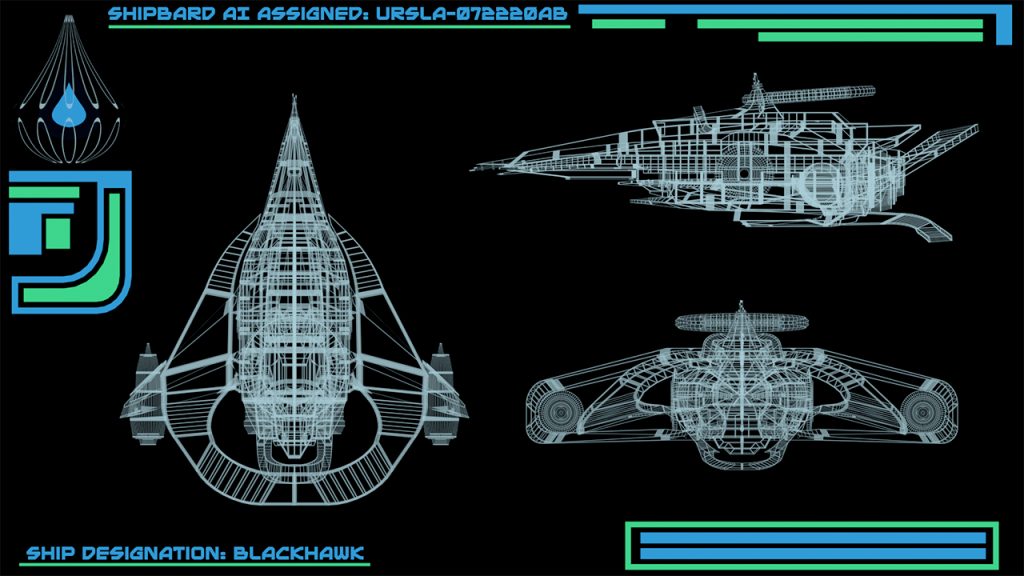

Alien Rescue è un’esperienza di fantascienza in realtà virtuale che si svolge sulla social VR platform Resonite, a cui uno o più spettatori paganti possono prendere parte nel ruolo di “eroi”. Accompagnati da attori in carne ed ossa che interpretano vari personaggi e da un pubblico di 15 persone nel ruolo di Eyebots silenti, gli eroi devono portare a termine una missione ambientalista di salvataggio all’interno di un’enorme astronave sul pianeta di Palnetter.

Il progetto, nato già dal 2018 dall’interesse per la VR di Jason Moore, regista e CEO di MetaMovie, si è caratterizzato in questi anni per la sua natura sperimentale che ha portato l’opera a rappresentare, oggi, uno degli esempi più longevi, elaborati e innovativi di produzione cinematica in realtà virtuale.

Con i suoi due anni e mezzo di spettacoli dal vivo – tutt’ora in corso – The MetaMovie Presents: Alien Rescue si colloca con orgoglio all’intersezione tra realtà virtuale, film e gioco di ruolo, ed è un ottimo esempio di un’opera che è stata in grado di coinvolgere il pubblico e di portare la realtà virtuale a coloro che non hanno economicamente e fisicamente l’opportunità di sperimentarla.

Creare la realtà: Intervista XR a Jason Moore

Lo scorso 5 marzo, XR4Europe, in collaborazione con XRMust, ha accompagnato noi spettatori, ma anche molti esperti del settore, in un viaggio/intervista alla scoperta di come Jason e il suo team “progettano, creano e iterano la loro produzione cinematografica immersiva all’interno di piattaforme come Resonite”.

l’entusiastica moderazione di Michael Barngrover ha aiutato Jason Moore, lo sviluppatore di Alien Rescue Zyzyl e gli attori Craig Woodword, Marinda Botha e Kenneth Rogeau a riflettere su diversi argomenti: modalità di lavoro e di costruzione dell’opera, ruolo del coding, rapporto fra attori, narrazione e improvvisazione, ma anche lo straordinario strumento di multicam rielaborato da Zyzyl che, sotto l’occhio vigile di Carlos Austin, diventa uno supporto potentissimo per trasformare una storia virtuale a cui pochi possono fisicamente accedere ad un’esperienza cinematica immersiva che apre le porte a nuove possibilità distributive e a nuovi pubblici.

Lavorare “on-site”: le potenzialità di connettersi da remoto in uno spazio comune

La dimostrazione parla chiaro: Jason e il suo team sono riusciti a costruire nel giro di pochi minuti, in diretta e spiegando al pubblico come fare, un inseguimento in macchina (e a dire il vero anche una sparatoria con esiti infelici per il regista…) sul set che di Alien Rescue, utilizzando gli intuitivi strumenti offerti da Resonite.

Non è la prima volta che artisti delle performing art ci raccontano di quanto efficace sia la co-creation direttamente in piattaforma (a breve torneremo a parlarne con la nostra intervista su The Saga of Sage), ma il lavoro di The MetaMovie è un’evidente conferma.

Potersi trovare fisicamente nello stesso posto, per quanto in modo virtuale, permette non solamente di superare le barriere geografiche, ma soprattutto di ottimizzare e velocizzare il processo di creazione in modo esponenziale.

Le figure coinvolte possono vedere in tempo reale i risultati di una modifica alle luci o agli oggetti di scena, ma anche lavorare simultaneamente nello stesso spazio ad aspetti diversi dell’opera per poi confrontarsi sul momento riguardo la loro efficacia. Possono consultarsi sulle necessità reciproche già in fase di creazione. E ancora, guardando ad esempio al momento delle prove, non è necessario che il regista manipoli attrezzatura, trovi location, gestisca fisicamente la scena, con costi economici e di tempo. Può semplicemente ingrandirsi virtualmente così da avere un maggior controllo su tutta la scena e su come coreografarla, osservando tutto dall’alto e gestendo la cosa come una location in miniatura e tanti soldatini giocattolo, gli attori, da muovere.

E ancora, per citare un altro esempio, quando prova una scena, il regista non ha bisogno di manipolare attrezzature, trovare luoghi e gestire fisicamente il set, con costi economici e di tempo. Può semplicemente ingrandirsi virtualmente così da guardare il tutto come se fosse una miniatura con soldatini da posizionare e avere così un maggior controllo della scena che facilita il processo coreografico.

Insomma, una serie di opportunità che aiutano tantissimo lo stage managing e, contemporaneamente, agevolano una valutazione immediata dei risultati.

Protoflux: usare il coding per dare maggior agency allo spettatore

Protoflux, il linguaggio di scripting basato su nodi offerto da Resonite, manipolabile direttamente nello spazio 3D, è uno degli strumenti più utili della piattaforma. Sebbene in molti, come ci ricorda Zyzyl, continuino a preferire un text-based coding – che probabilmente arriverà comunque, nel futuro, a Resonite – il linguaggio di scripting visivo permette un riscontro immediato al comando, con la possibilità di verificare subito la correttezza dello stesso e anche se il risultato è esteticamente quello voluto.

Anche in questo caso, l’operare direttamente in piattaforma ottimizza le tempistiche produttive, ma non è soltanto questo l’uso che Jason Moore e il suo team fanno dello strumento.

L’aspetto infatti essenziale, in cui Protoflux dimostra la sua utilità, è l’interazione con il pubblico al di fuori del mondo virtuale, e specificatamente i follower di The MetaMovie su Twitch.

Già da anni è ampiamente diffusa la tendenza di guardare persone giocare ai videogiochi più che giocarci in prima persona. Questo fenomeno è ancora più rilevante in ambito immersivo in quanto non tutti hanno le possibilità di dotarsi della strumentazione necessaria per accedere ai mondi virtuali, ancora di più a mondi di social VR come Resonite, che richiedono PCVR di alta qualità e non supportano i visori stand-alone.

Moore, fin dalle origini del suo lavoro con The MetaMovie, ha mostrato una tendenza importantissima, ovvero quella di voler connettere i mondi virtuali con quelli IRL. Questo per due ragioni primarie: in primo luogo perché è difficile spiegare l’eccitazione che molti provano per la VR senza un metodo pratico di mostrarla a chi non ha un visore. In secondo luogo, perché aprirsi ai servizi streaming amplia le possibilità di trovare nuovo pubblico e conseguentemente genera concretamente nuove revenue.

Con Protoflux, l’utente connesso online può interagire con l’esperienza virtuale attraverso l’uso di comandi che fanno accadere cose nel mondo virtuale mentre la storia è in svolgimento. Esplosioni, musica, effetti speciali: tutto può essere generato all’insaputa degli attori.

L’agency di coloro che seguono lo spettacolo solo in streaming viene dunque aumentata drasticamente da questo supporto, cosa che spinge molti a unirsi allo spettacolo più e più volte per provare nuove interazioni o magari anche a comprare un biglietto da “eroe” così da sperimentare in modo esponenziale la propria presenza nella storia.

Dare agenzia agli spettatori mantenendo le mani sul volonte del copione: aka sull’immane bravura degli attori immersivi

Non so voi, ma io quando vedo un attore che riesce a gestire una situazione di recitazione “dal vivo”, mi chiedo sempre se sia umano o se le sue capacità provengano direttamente dalla bacchetta di Harry Potter. Insomma, ho sempre guardato con infinita ammirazione questi professionisti al lavoro: non riesco a recitare un copione, figuriamoci a improvvisare, mi sembra davvero una magia.

La cosa straordinaria di The MetaMovie (che abbiamo trovato nel passato anche in altri brillanti esempi di teatro immersivo dal vivo come Finding Pandora: X o negli spettacoli dei nostri amici di Ferryman Collective) è che gli attori immersivi sono persino più bravi di così.

Trovandosi davanti spettatori nel ruolo di eroi a cui viene data la massima agency, devono confrontarsi con risposte e comportamenti spesso inaspettati che mettono in pausa il “copione” per diversi minuti. La loro bravura è quindi da ritrovarsi non solamente nel gestire la risposta alla scelta “interpretativa” dell’eroe di turno, ma anche nel riportare la storia sui binari corretti, per arrivare dalla scena iniziale a quella finale senza perdersi completamente lungo la strada.

Abbiamo una sceneggiatura di 100 pagine per Alien Rescue che gli attori hanno imparato a memoria in ogni dettaglio. E ogni volta che uno dei nostri cinque eroi apre la bocca per dire qualcosa, beh, questo interrompe il processo narrativo. Ogni volta che parlano, usciamo dalla sceneggiatura strutturata per entrare in uno scenario improvvisato con quella persona. […] Torniamo sempre alla sceneggiatura, una volta che quel momento improvvisato ha fatto il suo corso, perché ovviamente vogliamo mantenere la storia lineare. Quindi la grande sfida di questo tipo di attività interattiva è […] non vogliamo che lo spettacolo sia una sessione di improvvisazione aperta. Ma vogliamo anche permettere ai nostri eroi di sentirsi davvero parte della storia. Ed è qui che entra in gioco il talento di questi attori.

Jason Moore

Un talento proprio di una comunità di artisti in cui tutti stanno imparando tramite la sperimentazione, perché comunque si tratta ancora di una forma d’arte nuova.

Lo switcher tradizionale reso virtuale: il potere narrativo della multicam

Concludiamo questo recap dell’evento “Creating Reality: XR Interview with Jason Moore” con l’ultimo macro-argomento affrontato da Jason e dal suo team, ovvero quello della multicam.

Sebbene Resonite offra fra gli strumenti una streamer camera con una buona interfaccia, Moore, che ha un background cinematografico e televisivo e per lunghi anni ha lavorato proprio con la tecnologia multicam sia in studio che in remoto, ha cercato per diverso tempo di attivare un sistema multicam in Resonite.

La cosa è divenuta possibile tramite Zyzyl, che è riuscito, nonostante la complessità del progetto, a sviluppare questo sistema, ora divenuto uno degli strumenti principali usati dal team di The MetaMovie per “condividere la magia della VR con il mondo esterno, in un modo che una singola telecamera non può fare”.

Un utente di Twitch ha infatti oggi la possibilità, tramite la sapiente regia di Carlos Austin, il regista multicam della trasmissione, di osservare quanto avviene nel corso di uno spettacolo di Alien Rescue da diverse angolazioni, scoprendo varie prospettive (e anche i segreti di alcuni personaggi).

Si tratta sicuramente di un modo molto più cinematografico di presentare la storia e senza dubbio più coinvolgente di quello che potrebbe offrire un POV a telecamera singola o una tradizionale inquadratura dall’alto.

Alien Rescue è in partenza con nuovi show il prossimo 16 marzo. Potete acquistare i biglietti dal sito di The MetaMovie e scegliere di essere finalmente l’eroe della vostra storia e il protagonista del vostro film.

Ma se non avete la strumentazione, nessun timore: come abbiamo ricordato più volte The MetaMovie è anche su Twitch e anche da lì possiamo influenzare la narrazione e sorprendere un po’ il cast.

Come join the show, colleghi robottini.

Lascia un commento

Devi essere connesso per inviare un commento.